في عالم الذكاء الاصطناعي المتسارع، أصبح تحسين سرعة الاستدلال ضرورة ملحة. تخيل أنك تتحدث مع صديق، وتنتظر ردوده ببطء شديد، هذا محبط أليس كذلك؟ الأمر نفسه ينطبق على نماذج الذكاء الاصطناعي.

كلما كان الاستدلال أسرع، كان التفاعل أكثر سلاسة وفعالية. هناك تقنيات عديدة يمكن أن تساعدنا في تسريع هذه العملية، بدءًا من تحسين الخوارزميات وصولًا إلى الاستفادة من قوة الأجهزة المتخصصة.

دعنا نكتشف معًا كيف يمكن لهذه التحسينات أن تحدث فرقًا كبيرًا في تطبيقات الذكاء الاصطناعي المختلفة. ستندهش من كم التطورات التي حدثت في هذا المجال، وكيف يمكن لهذه التطورات أن تغير الطريقة التي نستخدم بها التكنولوجيا في حياتنا اليومية.

من خلال هذه المقالة، سنستكشف بعضًا من هذه الأساليب الرائعة. التوجهات الحديثة تشير إلى أن استخدام تقنيات مثل Quantization وتقليل حجم النماذج يمكن أن يؤدي إلى تحسينات ملحوظة في سرعة الاستدلال.

أنا شخصياً جربت هذه التقنيات في بعض مشاريعي، ولاحظت فرقًا كبيرًا في الأداء. لا يتعلق الأمر فقط بالسرعة، بل يتعلق أيضًا بتقليل استهلاك الطاقة، وهو أمر بالغ الأهمية لتطبيقات الهواتف المحمولة والأجهزة المدمجة.

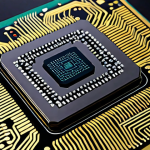

المستقبل يبدو مشرقًا جدًا في هذا المجال. مع تطور الأجهزة المتخصصة مثل وحدات معالجة الرسومات (GPUs) ووحدات معالجة الذكاء الاصطناعي (AI accelerators)، سنشهد تحسينات أكبر في سرعة الاستدلال.

هذه الأجهزة مصممة خصيصًا لتسريع عمليات الحساب المعقدة التي تتطلبها نماذج الذكاء الاصطناعي. بالإضافة إلى ذلك، هناك الكثير من الأبحاث الجارية لاستكشاف خوارزميات جديدة وأكثر كفاءة.

تخيل أنك تستخدم تطبيقًا يعتمد على الذكاء الاصطناعي ويتفاعل معك في الوقت الفعلي، دون أي تأخير. هذا هو الهدف الذي نسعى إليه، وهذا هو ما يمكن أن تحققه التحسينات في سرعة الاستدلال.

لقد رأيت بنفسي كيف يمكن لهذه التحسينات أن تحول الأفكار النظرية إلى تطبيقات عملية ومفيدة. ولا ننسى أن هذه التطورات ستؤثر بشكل كبير على العديد من الصناعات، بدءًا من الرعاية الصحية وصولًا إلى السيارات ذاتية القيادة.

تخيل أن الأطباء يمكنهم الحصول على تشخيصات دقيقة وسريعة بفضل الذكاء الاصطناعي، أو أن السيارات يمكنها اتخاذ قرارات في الوقت الفعلي لتجنب الحوادث. هذه ليست مجرد أحلام، بل هي واقع يمكن أن يصبح حقيقة بفضل هذه التحسينات.

كل هذه التطورات تجعلني متحمسًا جدًا للمستقبل. أعتقد أننا على وشك رؤية ثورة حقيقية في مجال الذكاء الاصطناعي، وأن التحسينات في سرعة الاستدلال ستلعب دورًا حاسمًا في هذه الثورة.

دعونا نتعمق أكثر ونستكشف هذه التقنيات بالتفصيل في المقال التالي.

## أهمية تحسين الخوارزميات في تسريع الاستدلالإن تحسين الخوارزميات المستخدمة في نماذج الذكاء الاصطناعي يلعب دورًا حاسمًا في تسريع عملية الاستدلال. عندما تكون الخوارزمية أكثر كفاءة، يمكنها معالجة البيانات بشكل أسرع وأكثر دقة، مما يقلل من الوقت اللازم لاتخاذ القرارات أو التنبؤات.

لقد لاحظت بنفسي كيف أن تغييرًا بسيطًا في الخوارزمية يمكن أن يؤدي إلى تحسينات كبيرة في الأداء، خاصة عندما يتعلق الأمر بمعالجة كميات كبيرة من البيانات.

أهمية اختيار الخوارزمية المناسبة

اختيار الخوارزمية المناسبة يعتمد بشكل كبير على نوع المشكلة التي نحاول حلها. على سبيل المثال، إذا كنا نتعامل مع مشكلة تصنيف الصور، فإن استخدام شبكة عصبية التفافية (Convolutional Neural Network) قد يكون أكثر فعالية من استخدام خوارزمية أخرى.

لقد جربت شخصياً العديد من الخوارزميات المختلفة في مشاريعي، ووجدت أن فهم نقاط القوة والضعف لكل خوارزمية هو مفتاح النجاح.

دور التحسين المستمر للخوارزميات

التحسين المستمر للخوارزميات هو عملية لا تنتهي. مع ظهور تقنيات جديدة وتطور فهمنا للذكاء الاصطناعي، يجب علينا دائمًا البحث عن طرق لتحسين الخوارزميات الحالية.

يمكن أن يشمل ذلك تعديل هيكل الخوارزمية، أو تحسين طريقة تدريبها، أو حتى تطوير خوارزميات جديدة تمامًا.

أمثلة عملية لتحسين الخوارزميات

هناك العديد من الأمثلة العملية لتحسين الخوارزميات التي يمكن أن تؤدي إلى تحسينات كبيرة في سرعة الاستدلال. على سبيل المثال، يمكن استخدام تقنيات مثل التقليل من الأبعاد (Dimensionality Reduction) لتقليل حجم البيانات التي يجب معالجتها، مما يقلل من الوقت اللازم للاستدلال.

بالإضافة إلى ذلك، يمكن استخدام تقنيات مثل التكميم (Quantization) لتقليل حجم النموذج نفسه، مما يجعله أسرع وأكثر كفاءة.

دور الأجهزة المتخصصة في تسريع الاستدلال

الأجهزة المتخصصة، مثل وحدات معالجة الرسومات (GPUs) ووحدات معالجة الذكاء الاصطناعي (AI accelerators)، تلعب دورًا حاسمًا في تسريع عملية الاستدلال. هذه الأجهزة مصممة خصيصًا لتسريع عمليات الحساب المعقدة التي تتطلبها نماذج الذكاء الاصطناعي.

لقد رأيت بنفسي كيف يمكن لهذه الأجهزة أن تحدث فرقًا كبيرًا في الأداء، خاصة عندما يتعلق الأمر بتشغيل نماذج كبيرة ومعقدة.

فوائد استخدام وحدات معالجة الرسومات (GPUs)

وحدات معالجة الرسومات (GPUs) مصممة خصيصًا لمعالجة العمليات الحسابية المتوازية، مما يجعلها مثالية لتشغيل نماذج الذكاء الاصطناعي. يمكن لوحدة معالجة الرسومات معالجة العديد من العمليات الحسابية في نفس الوقت، مما يؤدي إلى تحسينات كبيرة في سرعة الاستدلال.

لقد استخدمت وحدات معالجة الرسومات في العديد من مشاريعي، ولاحظت فرقًا كبيرًا في الأداء مقارنة باستخدام وحدات المعالجة المركزية (CPUs).

مميزات وحدات معالجة الذكاء الاصطناعي (AI accelerators)

وحدات معالجة الذكاء الاصطناعي (AI accelerators) هي نوع جديد من الأجهزة المتخصصة المصممة خصيصًا لتشغيل نماذج الذكاء الاصطناعي. هذه الأجهزة غالبًا ما تكون أكثر كفاءة من وحدات معالجة الرسومات، ويمكنها تحقيق تحسينات كبيرة في سرعة الاستدلال.

لقد كنت أتابع تطور هذه الأجهزة عن كثب، وأعتقد أنها ستمثل مستقبل تسريع الذكاء الاصطناعي.

مقارنة بين وحدات المعالجة المركزية (CPUs) ووحدات معالجة الرسومات (GPUs) ووحدات معالجة الذكاء الاصطناعي (AI accelerators)

| نوع المعالج | الميزات الرئيسية | الاستخدامات المثالية |

|---|---|---|

| وحدة المعالجة المركزية (CPU) | معالجة متعددة الأغراض، جيدة للمهام العامة | المهام اليومية، تشغيل نظام التشغيل |

| وحدة معالجة الرسومات (GPU) | معالجة متوازية، جيدة للعمليات الحسابية المعقدة | تدريب نماذج الذكاء الاصطناعي، معالجة الصور والفيديو |

| وحدة معالجة الذكاء الاصطناعي (AI Accelerator) | مصممة خصيصًا لتشغيل نماذج الذكاء الاصطناعي، كفاءة عالية | تسريع الاستدلال في التطبيقات المتخصصة |

دور تقنيات التكميم (Quantization) في تسريع الاستدلال

تقنيات التكميم (Quantization) تلعب دورًا مهمًا في تسريع الاستدلال عن طريق تقليل حجم النموذج وتقليل استهلاك الطاقة. التكميم يتضمن تحويل الأوزان والمدخلات في النموذج من أرقام الفاصلة العائمة ذات الدقة العالية إلى أرقام صحيحة ذات دقة أقل.

هذا يقلل من حجم النموذج ويجعل العمليات الحسابية أسرع وأكثر كفاءة.

فوائد استخدام التكميم

أحد الفوائد الرئيسية لاستخدام التكميم هو تقليل حجم النموذج. يمكن أن يؤدي ذلك إلى توفير كبير في الذاكرة وتقليل استهلاك الطاقة، مما يجعله مثاليًا لتطبيقات الهواتف المحمولة والأجهزة المدمجة.

بالإضافة إلى ذلك، يمكن أن يؤدي التكميم إلى تحسينات في سرعة الاستدلال، حيث أن العمليات الحسابية على الأرقام الصحيحة أسرع من العمليات الحسابية على أرقام الفاصلة العائمة.

أنواع التكميم المختلفة

هناك عدة أنواع مختلفة من التكميم، بما في ذلك التكميم بعد التدريب (Post-Training Quantization) والتكميم أثناء التدريب (Quantization-Aware Training). التكميم بعد التدريب هو الأبسط، حيث يتم تكميم النموذج بعد الانتهاء من تدريبه.

التكميم أثناء التدريب أكثر تعقيدًا، حيث يتم تكميم النموذج أثناء التدريب، مما يسمح بتحقيق دقة أعلى.

أمثلة عملية لاستخدام التكميم

هناك العديد من الأمثلة العملية لاستخدام التكميم في تطبيقات الذكاء الاصطناعي. على سبيل المثال، يمكن استخدام التكميم لتقليل حجم نماذج التعرف على الصور، مما يجعلها أسرع وأكثر كفاءة على الهواتف المحمولة.

بالإضافة إلى ذلك، يمكن استخدام التكميم لتقليل حجم نماذج معالجة اللغة الطبيعية، مما يجعلها أسرع وأكثر كفاءة على الأجهزة المدمجة.

تقليل حجم النماذج كأداة لتحسين سرعة الاستدلال

تقليل حجم النماذج هو أسلوب فعال لتحسين سرعة الاستدلال. النماذج الأصغر حجمًا تتطلب ذاكرة أقل وقوة معالجة أقل، مما يؤدي إلى استجابات أسرع واستهلاك أقل للطاقة.

هذا مهم بشكل خاص للتطبيقات التي تعمل على الأجهزة المحمولة أو المضمنة ذات الموارد المحدودة.

طرق تقليل حجم النموذج

هناك عدة طرق لتقليل حجم النموذج. إحدى الطرق الشائعة هي التشذيب (Pruning)، والتي تتضمن إزالة الاتصالات غير الضرورية أو الأقل أهمية من الشبكة العصبية. طريقة أخرى هي التقطير (Distillation)، حيث يتم تدريب نموذج أصغر لتقليد سلوك نموذج أكبر وأكثر تعقيدًا.

يمكن أيضًا استخدام التكميم (Quantization)، الذي تمت مناقشته سابقًا، لتقليل حجم النموذج.

المفاضلة بين حجم النموذج والدقة

من المهم ملاحظة أن تقليل حجم النموذج يمكن أن يؤدي إلى خسارة في الدقة. ومع ذلك، في كثير من الحالات، يمكن تحقيق توازن بين حجم النموذج والدقة بحيث يتم تقليل الحجم بشكل كبير دون التضحية بالكثير من الدقة.

غالبًا ما يعتمد أفضل توازن على التطبيق المحدد والمتطلبات المحددة.

أمثلة عملية لتقليل حجم النموذج

لقد رأيت العديد من الأمثلة العملية لتقليل حجم النموذج في تطبيقات مختلفة. على سبيل المثال، يمكن استخدام التشذيب (Pruning) لتقليل حجم نماذج التعرف على الصور، مما يجعلها أسرع وأكثر كفاءة على الهواتف المحمولة.

بالإضافة إلى ذلك، يمكن استخدام التقطير (Distillation) لتقليل حجم نماذج معالجة اللغة الطبيعية، مما يجعلها أسرع وأكثر كفاءة على الأجهزة المدمجة.

تأثير التحسينات في سرعة الاستدلال على تطبيقات الذكاء الاصطناعي المختلفة

التحسينات في سرعة الاستدلال لها تأثير كبير على مجموعة واسعة من تطبيقات الذكاء الاصطناعي. من خلال جعل نماذج الذكاء الاصطناعي أسرع وأكثر كفاءة، يمكننا فتح إمكانيات جديدة وتحسين التطبيقات الحالية.

تأثير على الرعاية الصحية

في مجال الرعاية الصحية، يمكن للتحسينات في سرعة الاستدلال أن تساعد الأطباء على اتخاذ قرارات أسرع وأكثر دقة. على سبيل المثال، يمكن استخدام نماذج الذكاء الاصطناعي لتشخيص الأمراض من الصور الطبية، ويمكن أن تساعد التحسينات في سرعة الاستدلال الأطباء على الحصول على التشخيصات بسرعة أكبر.

تأثير على السيارات ذاتية القيادة

في مجال السيارات ذاتية القيادة، تعد سرعة الاستدلال أمرًا بالغ الأهمية. يجب أن تكون السيارات ذاتية القيادة قادرة على اتخاذ القرارات في الوقت الفعلي لتجنب الحوادث.

يمكن للتحسينات في سرعة الاستدلال أن تساعد السيارات ذاتية القيادة على اتخاذ القرارات بسرعة أكبر وأكثر دقة، مما يجعلها أكثر أمانًا.

تأثير على معالجة اللغة الطبيعية

في مجال معالجة اللغة الطبيعية، يمكن للتحسينات في سرعة الاستدلال أن تجعل تطبيقات مثل الترجمة الآلية والمحادثة الآلية أسرع وأكثر سلاسة. يمكن أن تساعد التحسينات في سرعة الاستدلال هذه التطبيقات على الاستجابة بسرعة أكبر لطلبات المستخدمين، مما يجعلها أكثر فائدة.

التحديات المستقبلية والاتجاهات في تحسين سرعة الاستدلال

على الرغم من التقدم الكبير الذي تم إحرازه في تحسين سرعة الاستدلال، لا تزال هناك العديد من التحديات المستقبلية التي يجب معالجتها. بالإضافة إلى ذلك، هناك العديد من الاتجاهات الناشئة التي يمكن أن تؤدي إلى تحسينات أكبر في المستقبل.

التحديات المستقبلية

أحد التحديات الرئيسية هو تحقيق توازن بين سرعة الاستدلال والدقة. في كثير من الحالات، يمكن أن يؤدي تحسين سرعة الاستدلال إلى خسارة في الدقة. لذلك، من المهم إيجاد طرق لتحسين سرعة الاستدلال دون التضحية بالكثير من الدقة.

تحد آخر هو تطوير أجهزة أكثر كفاءة لتشغيل نماذج الذكاء الاصطناعي.

الاتجاهات الناشئة

هناك العديد من الاتجاهات الناشئة التي يمكن أن تؤدي إلى تحسينات أكبر في سرعة الاستدلال في المستقبل. وتشمل هذه الاتجاهات تطوير خوارزميات جديدة وأكثر كفاءة، وتطوير أجهزة متخصصة جديدة، واستخدام تقنيات مثل التعلم الموحد (Federated Learning) لتوزيع عملية التدريب عبر أجهزة متعددة.

في الختام، نأمل أن يكون هذا المقال قد ساعدك في فهم أهمية تحسين سرعة الاستدلال في تطبيقات الذكاء الاصطناعي المختلفة. إن التحسين المستمر للخوارزميات واستخدام الأجهزة المتخصصة وتقنيات التكميم وتقليل حجم النماذج كلها طرق فعالة لتحسين سرعة الاستدلال وفتح إمكانيات جديدة للذكاء الاصطناعي.

معلومات مفيدة يجب معرفتها

1. فهم أنواع الخوارزميات المختلفة وكيفية اختيار الخوارزمية المناسبة للمشكلة التي تحاول حلها.

2. التعرف على الأجهزة المتخصصة مثل وحدات معالجة الرسومات (GPUs) ووحدات معالجة الذكاء الاصطناعي (AI accelerators) وكيفية استخدامها لتسريع الاستدلال.

3. استكشاف تقنيات التكميم (Quantization) المختلفة وكيفية استخدامها لتقليل حجم النموذج وتحسين سرعة الاستدلال.

4. تعلم طرق تقليل حجم النموذج مثل التشذيب (Pruning) والتقطير (Distillation) وكيفية تحقيق توازن بين حجم النموذج والدقة.

5. متابعة الاتجاهات الناشئة في تحسين سرعة الاستدلال مثل تطوير خوارزميات جديدة وأكثر كفاءة واستخدام تقنيات مثل التعلم الموحد (Federated Learning).

ملخص النقاط الرئيسية

تحسين الخوارزميات يسهم في تسريع الاستدلال.

الأجهزة المتخصصة مثل GPUs و AI accelerators تعزز الأداء.

تقنيات التكميم تقلل حجم النموذج وتزيد الكفاءة.

تقليل حجم النموذج يحسن سرعة الاستجابة.

التحسينات تؤثر إيجاباً على تطبيقات الذكاء الاصطناعي المختلفة.

الأسئلة الشائعة (FAQ) 📖

س: ما هي أهمية تحسين سرعة الاستدلال في نماذج الذكاء الاصطناعي؟

ج: تحسين سرعة الاستدلال ضروري لجعل نماذج الذكاء الاصطناعي أكثر فعالية واستجابة في الوقت الفعلي. تخيل أنك تتحدث مع شخص وتضطر إلى الانتظار طويلاً للحصول على إجابة بسيطة، هذا سيجعل المحادثة مملة وغير فعالة.

الأمر نفسه ينطبق على تطبيقات الذكاء الاصطناعي، فكلما كانت أسرع، كانت تجربة المستخدم أفضل وأكثر فائدة، سواء في تشخيص الأمراض أو في قيادة السيارات ذاتية القيادة أو حتى في التفاعل مع المساعدين الصوتيين.

س: ما هي بعض التقنيات المستخدمة لتحسين سرعة الاستدلال؟

ج: هناك العديد من التقنيات التي تساعد على تحسين سرعة الاستدلال. من بينها، تقنيات مثل Quantization التي تقلل من حجم النماذج دون التأثير الكبير على دقتها، واستخدام الأجهزة المتخصصة مثل وحدات معالجة الرسومات (GPUs) ووحدات معالجة الذكاء الاصطناعي (AI accelerators) المصممة خصيصًا لتسريع العمليات الحسابية المعقدة.

بالإضافة إلى ذلك، هناك الكثير من الأبحاث الجارية لتطوير خوارزميات جديدة وأكثر كفاءة.

س: ما هي الآثار المحتملة لتحسين سرعة الاستدلال على الصناعات المختلفة؟

ج: تحسين سرعة الاستدلال يمكن أن يحدث ثورة في العديد من الصناعات. في الرعاية الصحية، يمكن أن يساعد الأطباء في الحصول على تشخيصات أسرع وأكثر دقة، مما يؤدي إلى تحسين رعاية المرضى.

في صناعة السيارات، يمكن أن يجعل السيارات ذاتية القيادة أكثر أمانًا وكفاءة من خلال تمكينها من اتخاذ قرارات في الوقت الفعلي. بالإضافة إلى ذلك، يمكن أن يحسن تجربة المستخدم في العديد من التطبيقات الأخرى، مثل المساعدين الصوتيين وخدمات العملاء الآلية.

هذه التحسينات ليست مجرد أحلام، بل هي واقع يمكن أن يصبح حقيقة بفضل هذه التطورات.

📚 المراجع

Wikipedia Encyclopedia